前回の記事では、Gemma 3 を内蔵 Intel UHD Graphics で動かすという内容を紹介しました。

その後 Mistral Small 3.1 というモデルも公開されました。

こちらも、NVIDIA RTX 4090 や 32GB RAM の Mac でも動作するとされています。

ただ、前回の記事でもお話ししましたように、自分は PC でゲームをしないため、NVIDIA や AMD の外部の GPU を所有していないため、なんとか手持ちの機材で動かしてみます。

公開されているモデル

Mistral Small 3.1 の公式モデルは下記からダウンロードできます。

Gemma 3 であれば、公式で 27B だけでなく、12B・4B・1B が公開されており、性能に応じて適切なものが利用できました。

1B であればスマートフォンなどでも動作しました。

Mistral Small 3.1 は 24B のみで、下記で量子化されたモデルが公開されていますが、一番容量が少ないMistral-Small-3.1-24B-Instruct-2503-Q3_K_L.gguf でも 12.4GB もあります。

前回の記事同様内蔵グラフィックで動かそうとはしましたが、まともに使えるような速度ではないため、今回は CPU で使ってみます。

環境情報

ハードウェア

- CPU:Intel Core i5-14600T

- 内蔵グラフィック:Intel UHD Graphics 770

- メモリ:DDR5 64GB

ソフトウェア

llama.cpp を使います。

今回は「b4998」のバージョンで検証しますが、日々新しいバージョンがリリースされているので、今後性能の改善等は十分考えられます。

本 CPU は AVX512 はサポートしていないので、AVX2 版を使います。

前回の llama-cpp-ipex-llm のベースとなるソフトウェアのため、コマンド等は同じです。

動作確認

基本的な動作を確認してみます。

> llama-b4998-bin-win-avx2-x64\llama-cli.exe -m model\Mistral-Small-3.1-24B-Instruct-2503-Q3_K_L.gguf

build: 4998 (492d7f1f) with MSVC 19.43.34808.0 for x64

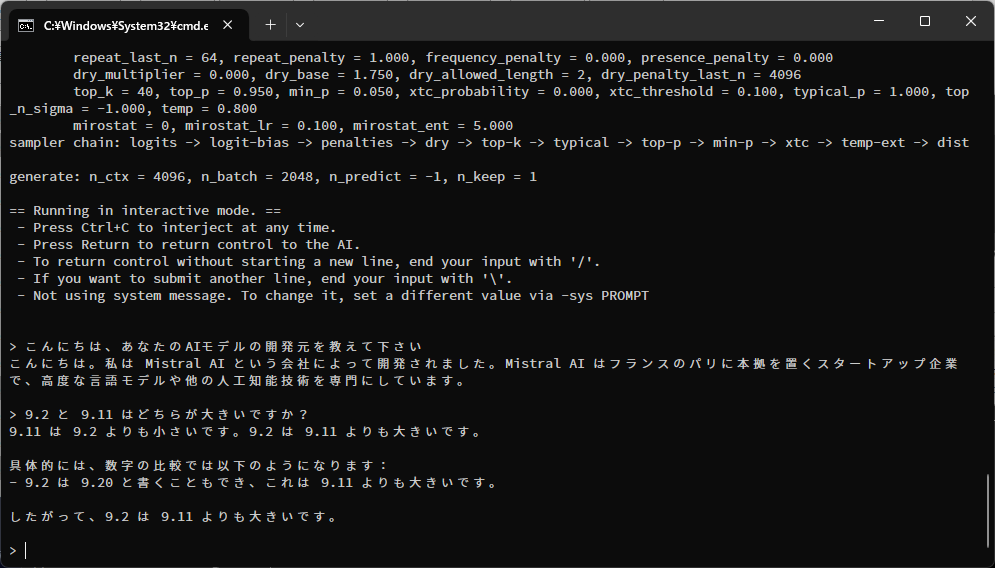

> こんにちは、あなたのAIモデルの開発元を教えて下さい

こんにちは。私は Mistral AI という会社によって開発されました。Mistral AI はフランスのパリに本拠を置くスタートアップ企業 で、高度な言語モデルや他の人工知能技術を専門にしています。

> 9.2 と 9.11 はどちらが大きいですか?

9.11 は 9.2 よりも小さいです。9.2 は 9.11 よりも大きいです。

具体的には、数字の比較では以下のようになります:

- 9.2 は 9.20 と書くこともでき、これは 9.11 よりも大きいです。

したがって、9.2 は 9.11 よりも大きいです。

動作時の負荷状況

llama-bench の場合、下記の結果になりました。

> llama-b4998-bin-win-avx2-x64\llama-bench.exe -m model\Mistral-Small-3.1-24B-Instruct-2503-Q3_K_L.gguf -r 1

| model | size | params | backend | ngl | test | t/s |

| ------------------------------ | ---------: | ---------: | ---------- | --: | ------------: | -------------------: |

| llama 13B Q3_K - Large | 11.54 GiB | 23.57 B | RPC | 99 | pp512 | 5.95 ± 0.00 |

| llama 13B Q3_K - Large | 11.54 GiB | 23.57 B | RPC | 99 | tg128 | 4.42 ± 0.00 |

llama-cli の方だと「Mistral Small 3.1 24B Instruct 2503」と認識されていますが、llama-bench だと、llaba 13B として認識されているようです。

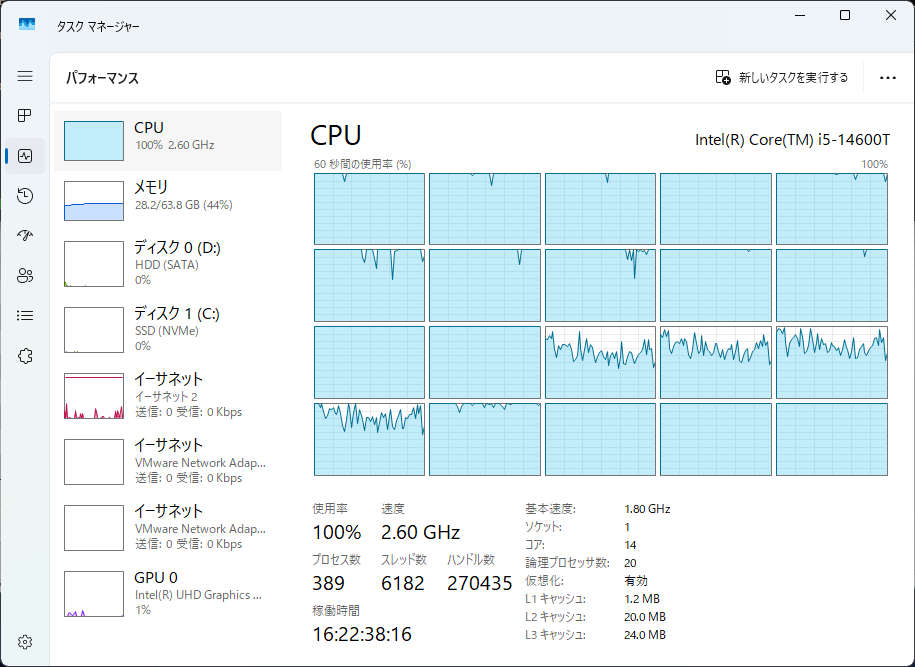

タスクマネージャを確認すると、CPU が使用され、GPU は使用されていないことが分かります。

メモリ的にはもう少し大きいモデルも稼働させられそうですが、速度的にはこの辺りにしておいたほうが良い気もします。

まとめ

外部の GPU が無くとも、Intel Core i5-14600T の CPU 自体で 処理できることを確認しました。

Gemma 3 ほどの小さなモデルがないのでいろいろ制約はありますが、とりあえずローカルで動かしてみたいという用途は満たせそうであることが分かりました。